Глобален Акциски Планиране за борба против злоупотреба со содржини поддржана од вештачка интелигенција за безбедноста на децата

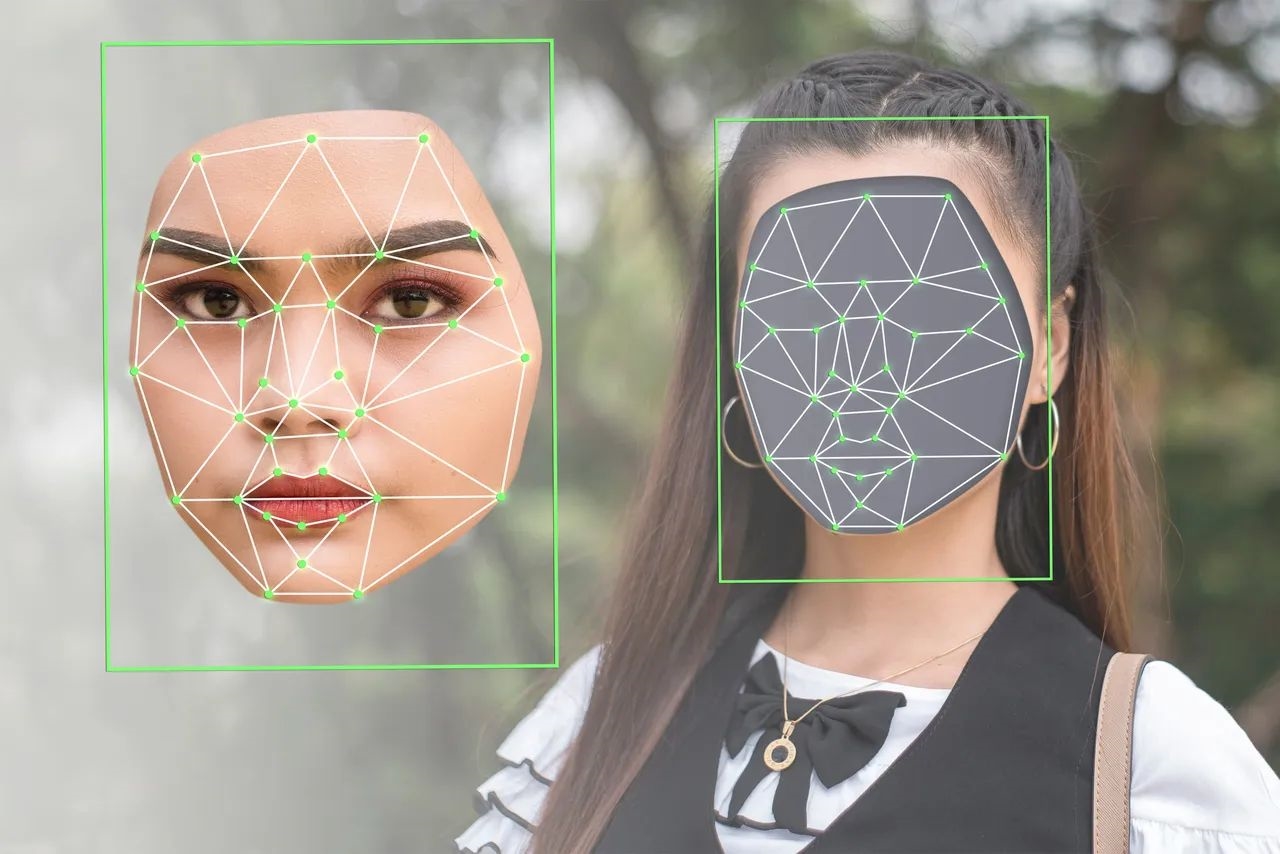

Брзото ширење на вештачката интелигенција покажува колку ефикасно технологијата се користи од страна на луѓето, а истовремено ја зголемува и ризикот од злоупотреба. Посебно, технологијата „deepfake“, која овозможува создавање на лажни слики на вистински лица со помош на вештачка интелигенција, создава нови закани надвор од дезинформациите и кршењето на приватноста. Податоците од УНИЦЕФ покажуваат дека во последната година, најмалку 1,2 милиони деца биле манипулирани со цел создавање на содржини со сексуална содржина преку deepfake. Internet Watch Foundation пак, ја пријавува зголемување од повеќе од 26 илјади проценти во овој сектор.

Ситуацијата во многу земји е уште посериозна; во голем анкетен истражување на 11 земји, се откри дека повеќе од 1,2 милиони деца чии слики биле нелегално променети со помош на алатки за вештачка интелигенција и претворени во материјали со сексуална содржина. Во некои региони, се наведува дека секоја 25-та дете е изложено на ризик од вакво злоупотреба; што значи дека најмалку едно дете во училишната средина можеби е жртва. УНИЦЕФ особено нагласува дека апликациите, познати како „nudification“, кои со помош на вештачка интелигенција го отстрануваат или менуваат облеката од фотографии, произведуваат голи или сексуализирани слики. Иако сликата не е реална, ако лицето и идентитетот се на детето, штетата веќе постои. Како што нагласува УНИЦЕФ, „deepfake злоупотребата е злоупотреба; причината за штетата не е лажноста, туку ефектот.“

Психолошкиот притисок што го создава deepfake врз децата не е ограничен само на видливите жртви; истражувањата покажуваат дека во некои земји, приближно две третини од децата кои учествувале во анкетата, се исплашени дека за нив се создаваат лажни содржини. Ова не само што претставува закана за сегашните штети, туку и за можни идни злоупотреби. УНИЦЕФ повикува на јасни чекори од страна на владите, и ја нагласува потребата за проширување на дефиницијата за „материјали за сексуално злоупотребување на деца (CSAM)“, така што таа да ги опфати содржините создадени со вештачка интелигенција. Исто така, треба јасно да се прогласи дека производството, стекнувањето и поседувањето на такви материјали е кривично дело. Истакнува се важноста од безбедносниот дизајн (safety-by-design), при што развивачите на вештачка интелигенција треба прво да ја градат безбедноста. Платформите треба да ги зајакнат механizмите за сп nego на содржини пред тие да се појават на мрежата.

Практични чекори од земјите Општо, Обединетото Кралство беше една од првите земји кои го криминализираа производството, поседувањето и дистрибуцијата на материјали за сексуална злоупотреба на деца со помош на вештачка интелигенција; за овие кривични дела е предвидена казна до пет години затвор. Меѓутоа, како што нагласува УНИЦЕФ, за ефикасно справување со оваа криза е потребен поширок и постојан пристап. Во овој процес, најголема одговорност има технолошките компании; решенијата за безбедност на терен треба да се фокусираат на заштитата на корисниците и да обезбедат безбедна дигитална еко-система за создавачите на содржини.