MoE Архитектура со GPU-ја: Nvidia GB200 NVL72 со баланс помеѓу перформансите и трошоците

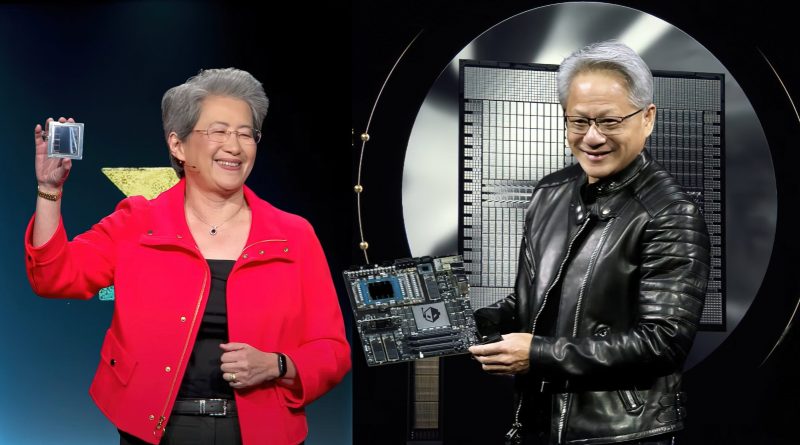

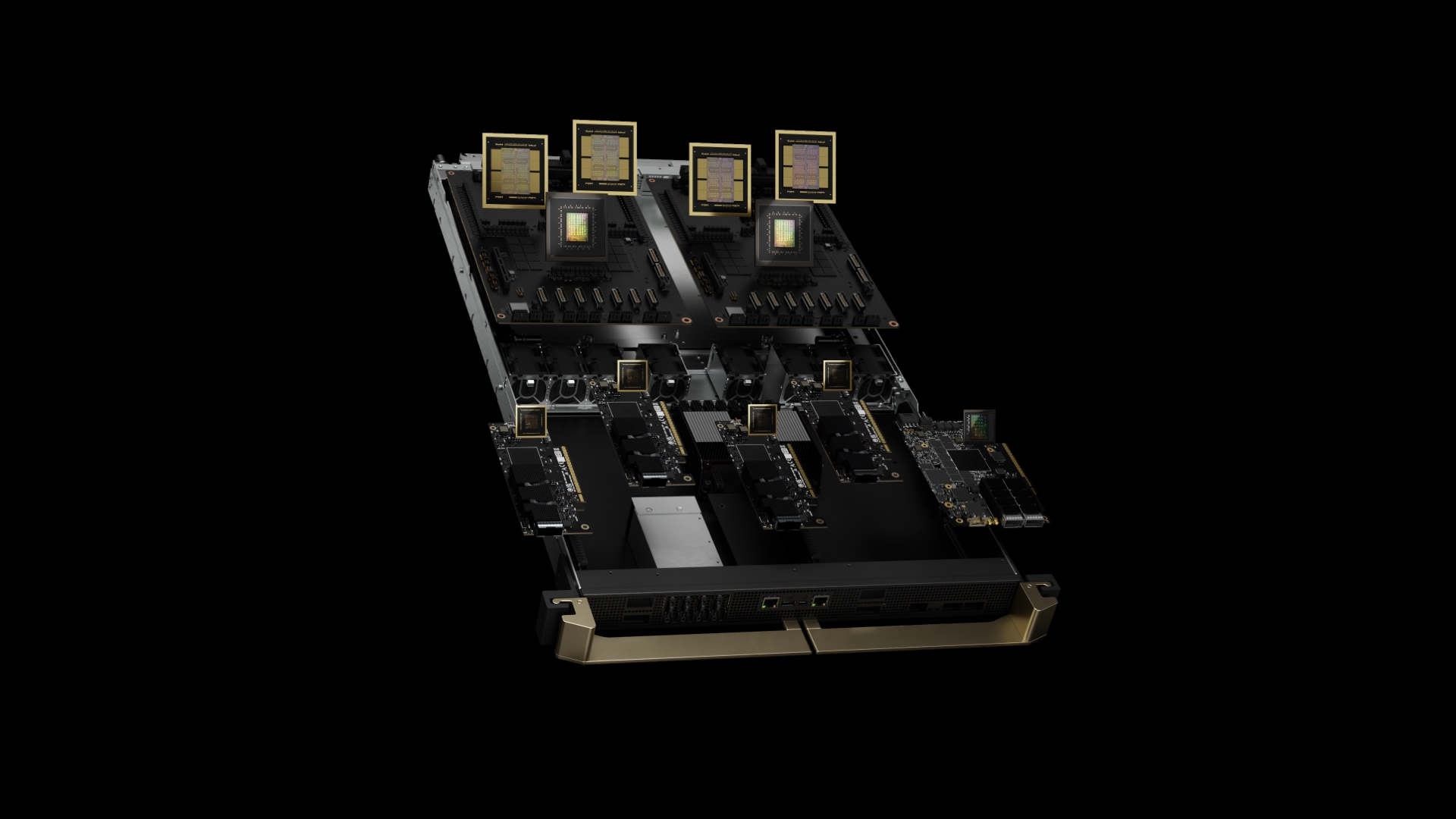

Во областа на вештачката интелигенција, архитектурата Mixture of Experts (MoE) стана популарна, додека конкуренцијата во хардверската област се заострува паралелно. Новата анализа, објавена од Signal65 и базирана на податоците од SemiAnalysis’s InferenceMAX, покажува дека системите за тргување GB200 NVL72 базирани на Blackwell Nvidia се подобри од AMD Instinct MI355X решенијата. Се наведува дека во MoE работни товари се постигнува разлика во перформансата од **околу 28 пати** по GPU. Додека моделите се делат така што секој одговорен мрежен дел работи само при секоја интерпелација, со растот на скалата, зголемувањето на интензитетот на пренос на податоци меѓу јадрата, латенцијата и оптоварувањето на пропусниот опсег стапуваат нагоре. Затоа, големите провајдери како AWS, Google Cloud, Microsoft Azure и Oracle Cloud се фокусираат не само на суровата перформанса, туку и на ефикасноста во трошоците за перформанси. Според наодите на Signal65, најоптималното решение за овој сегмент е Nvidia GB200 NVL72. Комбинацијата од 72 чипови и 30 TB споделена меморија обезбедува ефективност преку интегрирана работа во еден орман. Во анализата се нагласува дека оваа архитектура е развиена со „Extream Co-Design“ пристап за да ги надмине пречките во скалата на MoE.